【Gemini 3.1 Flash Live】いつから?無料の使い方や英会話・カメラ活用術

【この記事にはPRを含む場合があります】

最近、「スマホで調べ物をするのに、いちいち文字を打ち込むのが面倒だな……」「もっと人間みたいに自然に会話してくれるAIがあればいいのに」と思ったことはありませんか? そんな私たちの願いを叶える、驚くべき最新AIモデルがGoogleから登場しました。それが、「Gemini 3.1 Flash Live」です。

この記事では、AI初心者の方でもすぐに実践できるよう、Gemini 3.1 Flash Liveがどのようなものか、iPhoneやAndroidでの使い方、そして日常生活を劇的に便利にする活用方法まで、わかりやすく解説します。 この記事を読むことで、スマホやPCがまるで「優秀な専属アシスタント」に変わる体験を、今日からすぐに始められるようになります。

- 【音声AIの革命】Google Gemini 3.1 Flash Liveとは?いつから使えるのかも解説

- 従来の音声AIと何が変わった?3つの圧倒的な進化

- 無料で使える?Gemini 3.1 Flash LiveのiPhone・Android・PC別の使い方

- カメラやAPI連携でどんなことに使える?

- 日常生活を劇的に変える便利な使い方5選

- Q. 英語の勉強に使えますか?

- Q. 外出先で困ったときに助けてもらえる?

- Q. 大事な本番の前に練習相手になってくれる?

- Q. 思いついたアイデアを忘れないようにするには?

- Q. プログラミングの勉強にも使える?

- 利用するメリットと注意すべきポイント

- これからのAIは「文字」から「会話」へ

【音声AIの革命】Google Gemini 3.1 Flash Liveとは?いつから使えるのかも解説

(出典:Google)

Google Gemini 3.1 Flash Liveとは、Googleが2026年3月26日に発表した、リアルタイムで人間のように自然な会話ができる最新の「音声・視覚AIモデル」です。

これまでも音声でやり取りできるAIは存在していましたが、Gemini 3.1 Flash Liveは「見聞きしたものを瞬時に理解し、即座に反応する」という点で、過去のAIとは一線を画しています。

主な特徴は以下の通りです。

- リアルタイムの対話能力

人間と話しているのと同じようなペースで、自然な会話が可能です。 - マルチモーダル対応

音声だけでなく、テキスト、画像、動画(カメラ映像)を同時に理解できます。 - 多言語対応

90以上の言語に対応しており、世界中の言語でリアルタイムなコミュニケーションが可能です。

いつから使えるのか気になっていた方も多いと思いますが、2026年3月末の発表と同時に、世界中で順次利用が開始されています。

従来の音声AIと何が変わった?3つの圧倒的な進化

(出典:Google)

Gemini 3.1 Flash Liveの最大の進化は、「音声をテキストに変換する無駄を省いたこと」による圧倒的なスピードと、「人間の感情や周囲の状況を理解する能力」の向上です。

これまでの音声AIは、「ユーザーの音声をテキストに変換」→「AIがテキストで回答を作成」→「テキストを音声に変換して読み上げる」というプロセスを踏んでいたため、どうしても不自然な「間」や遅延が発生していました。

Gemini 3.1 Flash Liveは、以下の3つの点で劇的な進化を遂げています。

- タイムラグのない「ネイティブ音声処理」

音声を音声のまま直接処理するため、ローディングや不自然な一時停止がなく、まるで本物の人間と電話で話しているかのようなレスポンスを実現しています。会話中にユーザーが割り込んでも、瞬時にAIが話を止め、自然に対応してくれます。 - ノイズの多い環境でも正確に聞き取る

交通渋滞の音や、テレビの音が流れているような騒がしい環境下でも、ユーザーの声だけを的確に拾い上げ、正確に指示を理解することができます。 - 声のトーンや感情を読み取る

ユーザーが話すペースや声の高低、さらには「イライラしている」「混乱している」といった感情のニュアンスまでを理解し、それに合わせて話し方や回答のトーンを自動的に調整してくれます。

ここで、従来の音声AIとGemini 3.1 Flash Liveの違いを表で比較してみましょう。

| 比較項目 | 従来の音声AI | Gemini 3.1 Flash Live |

|---|---|---|

| 処理方式 | 音声 → テキスト → 音声 | 音声 → 音声(直接処理) |

| 応答スピード | 数秒のタイムラグがある | リアルタイム(ラグなし) |

| 会話への割り込み | AIの話が終わるまで待つ必要がある | いつでも割り込み可能 |

| 感情の理解 | 単語の意味のみを処理 | 声のトーンや感情(苛立ち等)を理解 |

| 視覚(カメラ)対応 | 非対応、または別の操作が必要 | 映像を見ながらリアルタイム会話が可能 |

無料で使える?Gemini 3.1 Flash LiveのiPhone・Android・PC別の使い方

Gemini 3.1 Flash Liveは、Googleアカウントさえあれば、iPhoneやAndroidのアプリ、またはPCブラウザから「無料」で使い始めることができます。

専門的な知識がなくても、以下の方法で簡単に最新の音声AIを体験できます。用途に合わせて使い分けてみてください。

手順リスト:iPhone・Androidアプリで使う方法

日常的な調べ物や雑談には、スマホアプリが最も手軽でおすすめです。

- お使いのスマホに「Google Gemini」アプリをダウンロードします(iPhoneはApp Store、AndroidはGoogle Playから)。

> Google Playストア「Google Gemini」アプリダウンロードページはこちら(Android用)

> AppStore「Google Gemini」アプリダウンロードページはこちら(iPhone用) - アプリを開き、Googleアカウントでログインします。

- 画面に表示されている「Gemini Live」のアイコン(または音声入力ボタン)をタップします。

- そのままスマホに向かって話しかけるだけで、リアルタイムの会話がスタートします。

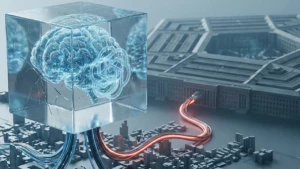

手順リスト:PCの「Google AI Studio」で使う方法

カメラを使った視覚機能や、画面共有、より高度な設定を試したい場合は、開発者向けの「Google AI Studio」を利用します(一般ユーザーでも無料で利用できます)。

- PCのブラウザから「Google AI Studio」にアクセスし、ログインします。

- 画面中央に表示される「Start building with Gemini」の中から、「Real-time」を選択します。

- モデル選択画面で「Gemini 3.1 Flash Live Preview」を選びます。

- 「Talk(話す)」「Webcam(カメラ)」「Share Screen(画面共有)」のいずれかを選び、マイクやカメラの許可を出せば利用開始です。

※ AI Studioでの利用は無料枠(APIキーなし)が用意されていますが、利用回数や機能に一定の制限があります。より本格的に自社のアプリやシステムに組み込んで利用したい場合は、有料のAPIキーを取得することも可能です。

カメラやAPI連携でどんなことに使える?

(出典:Google)

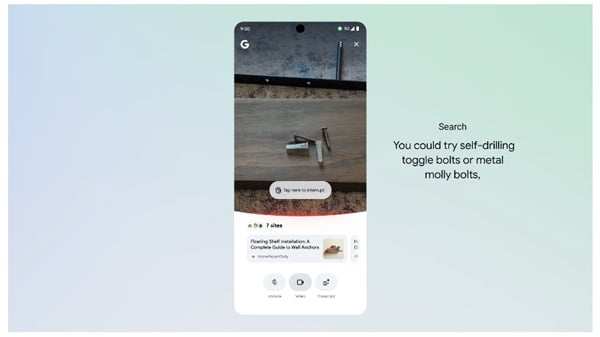

Gemini 3.1 Flash Liveは単なるおしゃべりツールではありません。カメラ(視覚)を通じた状況認識や、APIを利用した「行動(ツールの実行)」が可能です。

これまでのAIは「質問に答えるだけ」でしたが、Gemini 3.1 Flash Liveはあなたの指示に従って実際に行動を起こす「エージェント」として機能します。

- カメラ(Webカメラ)を使った状況解説

スマホのカメラやPCのWebカメラをオンにした状態で、「今手に持っているこれは何?」「この機械の直し方を教えて」と話しかけると、AIが映像をリアルタイムで解析し、音声で解決策を教えてくれます。 - 画面共有(Screen Share)によるサポート

PCの画面をAIと共有しながら、「このウェブサイトのデザイン、どこを直せばいいと思う?」「エラーが出たんだけど、画面を見て解決方法を教えて」といった、高度なトラブルシューティングやアドバイスをもらうことができます。 - 「Vibe Coding(バイブコーディング)」によるアプリ開発

コードの書き方がわからなくても、AIに「ダークモードのToDoアプリを作って」と話しかけるだけで、AIがリアルタイムでコードを書き、アプリを目の前で構築してくれます。「ボタンをもっと大きくして」などと口頭で修正指示を出すだけで、どんどんアプリが完成していきます。 - APIを利用したシステム連携(Function Calling)

開発者向け機能である「Live API」を使えば、AIに「明日午後3時にカレンダーに会議の予定を入れて」と指示して実際にスケジュールを登録させたり、自社のウェブサイトに「音声で対応するカスタマーサポートボット」を組み込んだりすることが可能です。

日常生活を劇的に変える便利な使い方5選

(出典:Google)

「機能がすごいのはわかったけれど、普通の生活でどう使えばいいの?」という疑問にお答えします。ここでは、スマホを使って日常を便利にする具体的な使い方を5つ厳選しました。

Q. 英語の勉強に使えますか?

A. ネイティブ以上の「英会話チューター」として最強です!

90以上の言語に対応しているため、「今日から毎日5分、カフェでの注文の英会話練習に付き合って」とお願いするだけで、優秀なネイティブ講師に早変わりします。発音のミスをその場で優しく指摘してもらうことも可能です。

Q. 外出先で困ったときに助けてもらえる?

A. カメラ機能が「専属のガイド」になります!

海外旅行先で読めないメニューをカメラで映して「これってどんな料理?」と聞いたり、道端に咲いている花を映して「この花の名前は何?」と聞いたりすることができます。タイピングの手間が一切ありません。

Q. 大事な本番の前に練習相手になってくれる?

A. 面接やプレゼンの「シミュレーション相手」として活躍します!

「私が応募者になるので、IT企業の採用面接官になりきって、厳しい質問をしてください」と指示すれば、リアルタイムの面接練習ができます。声の震えや戸惑いをAIが察知して、「少し緊張しているようですね、リラックスして」とフィードバックをくれることもあります。

Q. 思いついたアイデアを忘れないようにするには?

A. 散歩中や運転中の「音声メモ・思考整理ツール」として使えます!

両手がふさがっている移動中などに、「今思いついたブログの企画なんだけど、一緒に内容を整理してくれない?」と話しかけるだけで、AIが壁打ち相手となり、複雑な思考を整理してくれます。

Q. プログラミングの勉強にも使える?

A. 画面を共有しながら「マンツーマンのプログラミング講師」になります!

エラー画面をAIに共有しながら「なぜこのエラーが出るの?」と聞けば、視覚情報とコードを組み合わせて、的確な解決策を声で教えてくれます。

利用するメリットと注意すべきポイント

Gemini 3.1 Flash Liveは私たちの生活を大きく変える可能性を秘めていますが、利用する上で知っておくべきメリットと注意点があります。

メリット

- 完全なハンズフリー操作が可能

キーボードや画面のタップが不要になり、声だけであらゆる操作が完結します。 - 人間関係のストレスゼロ

人間に聞くのは恥ずかしい初歩的な質問や、何度同じことを聞いても、AIなら嫌な顔一つせず、何度でも丁寧に答えてくれます。 - 圧倒的な時間短縮

長文を読む代わりに、AIに資料を読み込ませて「要約して教えて」と声で頼むだけで、瞬時に情報をインプットできます。

注意点(デメリット)

- インターネット接続が必須

常にクラウド上のAIと通信するため、安定した高速インターネット環境(Wi-Fiやデータ通信)が必要です。 - API機能の非同期関数呼び出しは未対応

開発者向けの機能において、2026年3月時点ではツールの実行中(カレンダー検索など)にAIが沈黙して待機してしまう仕様(非同期関数呼び出し未対応)となっており、今後のアップデートが待たれます。 - 機密情報の取り扱いに注意

AI Studioの無料枠を利用する場合、入力したデータがAIの学習に利用される可能性があります。仕事の機密情報や個人情報は入力しないようにしましょう。

これからのAIは「文字」から「会話」へ

(出典:Google)

Google Gemini 3.1 Flash Liveの登場により、AIとのコミュニケーションは、キーボードで文字を打ち込む時代から、自然に「会話」をする時代へと本格的に突入しました。

この記事の要点を振り返ります。

- Gemini 3.1 Flash Liveは、タイムラグなしで人間のように会話できる最強の音声AI。

- iPhoneやAndroidアプリ、PCのAI Studioから基本無料で利用可能。

- カメラ映像や画面の共有により、目の前の状況に応じたリアルタイムサポートが受けられる。

- 英会話の練習、面接対策、日常のトラブル解決など、使い道は無限大。

これからの時代、AIを「難しいテクノロジー」と捉えるのではなく、「いつでも相談できる頼もしい相棒」として日常に取り入れることが、仕事や生活をより豊かにする鍵となります。

まずは、お手元のスマートフォンのGeminiアプリを開くか、PCでGoogle AI Studioにアクセスして、Gemini 3.1 Flash Liveに「今日の天気はどう?」「おすすめの夕食のレシピを教えて」と、気軽に声をかけてみてください。その自然な反応に、きっと驚くはずです!

> Google Playストア「Google Gemini」アプリダウンロードページはこちら(Android用)

> AppStore「Google Gemini」アプリダウンロードページはこちら(iPhone用)

みんなのらくらくマガジン 編集長 / 悟知(Satoshi)

SEOとAIの専門家。ガジェット/ゲーム/都市伝説好き。元バンドマン(作詞作曲)。SEO会社やEC運用の経験を活かし、「らくらく」をテーマに執筆。社内AI運用管理も担当。