Cerebras(セレブラス)とは?NVIDIAに挑む超巨大AIチップと驚異の推論速度

【この記事にはPRを含む場合があります】

「最近のAIは賢いけれど、もっとリアルタイムに、人間のように素早く反応してくれないだろうか」 「NVIDIAのAIチップが市場を独占していると聞くけれど、対抗できる企業は存在しないの?」

AI技術がビジネスや日常生活に深く浸透する中、このような疑問を抱いている方は多いのではないでしょうか。高度なAIモデルを動かすためには膨大な計算資源が必要であり、これまではNVIDIA製のGPUがその役割をほぼ独占してきました。しかし今、AIの「推論速度」においてNVIDIAを圧倒し、業界の勢力図を根本から塗り替えようとしている企業が存在します。それが、超巨大AIチップを武器に2026年5月にナスダックへ上場した「Cerebras Systems(セレブラス・システムズ)」です。

この記事を読むことで、Cerebrasがどのような技術を用いてAI処理を高速化しているのか、なぜAI界の巨人であるOpenAIが彼らと巨額の契約を結んだのか、そしてAIインフラ市場の未来がどう変化していくのかを、誰よりも深く理解することができます。

Cerebras Systems(セレブラス)とは?どこの国の会社?

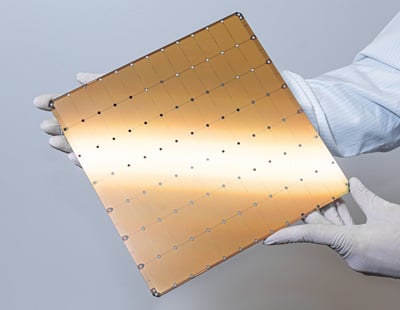

(出典:Cerebras Systems)

Cerebras Systems(セレブラス・システムズ)は、アメリカのカリフォルニア州サニーベールに本社を置く、AI(人工知能)に特化した半導体メーカーです。独自に開発した超巨大なAIチップを用いることで、従来のGPUをはるかに凌ぐデータ処理速度を実現しています。

Cerebras Systemsは2015年に、Andrew Feldman(アンドリュー・フェルドマン)をはじめとする5人の共同創業者によって設立されました。Feldman氏は過去にサーバー企業のSeaMicroを立ち上げ、AMDに約334万ドル(約350億円)で売却した実績を持つ連続起業家です。

同社の最大の特徴は、AIのディープラーニング(深層学習)を圧倒的な速度で処理するための専用コンピューターシステムを構築している点にあります。設立当初から、「グラフィック処理のために作られたGPUは、AI処理にとって最適なハードウェアではない」という考えに基づき、ゼロからAIに最適化された新しいアーキテクチャの設計に取り組んできました。現在では世界中の最先端のAI研究機関や大企業で導入され、AI開発の最前線を支える重要なインフラ企業へと成長しています。

Cerebrasの何がすごい?超巨大AIチップ「WSE-3」の正体

Cerebrasの強みは、シリコンウェハーを裁断せずに丸ごと1枚を1つのチップとして利用する「ウェハースケール・エンジン(Wafer-Scale Engine)」という唯一無二の技術にあります。これにより、チップ間の通信遅延を完全に排除し、桁違いの処理速度とメモリ帯域を実現しています。

現在のAIモデルはパラメータ数が数千億から数兆規模に膨れ上がっており、NVIDIAのシステムでは数千個の小さなGPUをネットワークケーブルでつなぎ合わせて処理を行っています。しかし、この方法ではチップ間でデータをやり取りする際に物理的な時間のロス(通信ボトルネック)が発生します。

Cerebrasが開発した最新チップ「WSE-3」は、ディナープレートほどの大きさがあり、NVIDIAのフラッグシップモデルの50倍以上の面積を誇ります。この1枚のチップ上に、以下の驚異的なスペックが詰め込まれています。

- 4兆個のトランジスタ

- 90万個のAI最適化コア

- 44GBのオンチップSRAM

- 21ペタバイト/秒のメモリ帯域幅

チップからデータを外部に出すことなく内部の超高速なネットワークだけで計算を完結できるため、AIの「推論(ユーザーの入力に対して回答を生成する処理)」において、NVIDIAの最上位システムと比較して最大で15倍〜20倍以上の速度を叩き出します。実際に、Llama 3.1 70Bなどの大規模言語モデルにおいて、1秒間に450〜2000トークン以上を出力することが可能です。

実際にCerebrasの推論速度がどれほど圧倒的か、実際の動作画面で比較した動画をご覧ください。

この動画では、Cerebrasが開発したAIモデルの文章生成速度が紹介されています。一般的なGPUが1秒間に約20文字の生成に留まるのに対し、Cerebrasのシステムは1秒間で400トークン以上を出力し、人間とリアルタイムで会話しているかのような驚異的なレスポンスを実現していることが確認できます。

NVIDIAのGPUとCerebrasのAIチップの違いは?

NVIDIAとCerebrasの決定的な違いは、ハードウェアのアーキテクチャ構造と、最も力を発揮する処理の領域(学習か推論か)にあります。NVIDIAが「分散処理と汎用性」を強みとする一方、Cerebrasは「単一チップでの超高速・低遅延処理」に特化しています。

NVIDIAのシステムは、多くのタスクを並行して行うバッチ処理や、AIモデルをゼロから鍛え上げる「学習(Training)」フェーズにおいて絶対的な強さを誇ります。しかし、学習したAIを利用してユーザーに瞬時に回答を返す「推論(Inference)」フェーズでは、データ移動のロスが原因で遅延が生じます。

一方のCerebrasは、全てのデータを1つのチップ上のメモリに保持して瞬時に計算する仕組みのため、リアルタイム性が求められる推論フェーズで真価を発揮します。

両者の特徴をわかりやすく比較表にまとめました。

| 比較項目 | NVIDIA(H100 / B200等) | Cerebras Systems(WSE-3 / CS-3) |

|---|---|---|

| アーキテクチャ | 小さなチップを多数繋ぐ「クラスタ構成」 | ウェハー1枚を丸ごと使った「ウェハースケール」 |

| メモリ配置 | チップ外部のHBM(広帯域メモリ)に依存 | チップ内部のSRAMを大容量搭載 |

| 得意な処理領域 | 大規模なモデルの「学習(Training)」と汎用処理 | 超低遅延が求められる「推論(Inference)」 |

| ソフトウェアの強み | 開発者エコシステム「CUDA」が業界標準 | PyTorch等に対応するがエコシステムは発展途上 |

NVIDIAは「CUDA」と呼ばれるソフトウェア開発環境で市場の80%以上を握っており、この強力なエコシステムが他社の参入を阻む大きな壁となっています。Cerebrasはこの壁を越えるため、推論速度という圧倒的な物理的メリットを武器に市場を切り開いています。

OpenAIはなぜCerebrasを独占採用したのか?

OpenAIがCerebrasを独占採用した理由は、リアルタイムな推論処理の速度を極限まで高めつつ、特定のサプライヤー(NVIDIA)への過度なインフラ依存から脱却するためです。

2026年1月、ChatGPTの開発元であるOpenAIは、Cerebrasと最大200億ドル(約3兆円)規模におよぶ計算能力の長期提供契約を結びました。さらにOpenAIは、リアルタイムなプログラミング支援を行う最新AIモデル「GPT-5.3 Codex Spark」の稼働インフラとして、NVIDIAのGPUではなくCerebrasの「WSE-3」を独占的に採用しています。

OpenAIがNVIDIA以外の選択肢を取った背景には、明確な戦略があります。

- リアルタイム性の追求

プログラマーのコード入力を支援するAIや、瞬時の会話が求められる音声AIエージェントにおいては、数秒の遅延がユーザー体験を致命的に損ないます。推論速度に特化したCerebrasのシステムは、この課題を解決する最適解でした。 - インフラ調達の分散化(4トラック戦略)

OpenAIはインフラの命綱をNVIDIA一社に握られるリスクを避けるため、「NVIDIA」「AMD」「Cerebras」「自社製ASIC」の4つのトラックでチップ調達を分散させる戦略をとっています。 - 財務的・戦略的な深い結びつき

OpenAIは単なる顧客ではなく、Cerebrasに対して10億ドルの運転資金を無利子で貸し付け、さらに株式の約10%を取得できるワラント(新株予約権)を保有しています。CEOのSam Altman(サム・アルトマン)氏らも個人投資家として名を連ねており、Cerebrasは事実上「OpenAI系列のインフラ」として機能しつつあります。

OpenAIがCerebrasを独占採用したのは、単なる「NVIDIAへの対抗」という表面的な理由だけではありません。NVIDIA、AMD、Cerebras、そして自社開発のカスタムチップを使い分ける「4トラック戦略」により、一社への依存リスクを回避しながら推論市場での優位性を確保しようとする、したたかなインフラ戦略が裏に隠されているのです。

AI市場最大のIPO!なぜ今Cerebrasは上場したのか?

Cerebrasが2026年5月に上場を果たした最大の理由は、かつての大きな懸念材料であった「特定顧客への売上依存」をクリアし、OpenAIという絶対的なアンカー顧客を獲得してビジネスの基盤が強固になったためです。さらに、爆発的に拡大するAI推論市場でシェアを獲得するための巨額の製造・開発資金を市場から調達する狙いがあります。

Cerebrasは2026年5月14日にナスダック市場へ上場(ティッカーシンボル:CBRS)し、アメリカのIPO市場において2026年最大の規模となりました。当初設定されていた1株あたりの公開価格は115〜125ドルでしたが、機関投資家からの需要が殺到して20倍以上のオーバーサブスクライブとなり、最終的に185ドルへ引き上げられました。上場初日の取引では初値が350ドルに急騰し、時価総額は一時1000億ドル(約15兆円)を突破する歴史的な熱狂を見せました。

実は、Cerebrasは過去にも上場を計画していましたが、撤回した経緯があります。その主な理由が以下の2点でした。

- G42への過度な売上依存と安保リスク

以前のCerebrasは、売上の80%以上をアラブ首長国連邦(UAE)のAI企業「G42」に依存していました。G42は中国企業とのつながりが指摘されており、アメリカの対米外国投資委員会(CFIUS)による国家安全保障上の審査対象となり、上場の足かせとなっていました。 - リスクの解消と新たな巨大スポンサーの獲得

その後、CerebrasはG42の資本を整理してCFIUSの審査をクリアし、新たにOpenAIと約200億ドルの超大型契約を締結しました。これにより「中国リスクを抱えた企業」から「世界最大のAI企業(OpenAI)を支える中核インフラ」へと市場の評価が完全に反転し、満を持してのIPO成功へと繋がりました。

AI半導体市場の未来と私たちが取るべきアクション

ここまで、Cerebras Systemsの画期的な技術と、AI業界における劇的な地殻変動について解説してきました。記事の重要なポイントを振り返ります。

- ウェハースケール技術による圧倒的な推論速度

Cerebrasは巨大な1枚のチップ(WSE-3)により、NVIDIAのGPUが抱える通信のボトルネックを解消し、推論処理において15倍〜20倍の高速化を実現しました。 - NVIDIA一強からの脱却と棲み分け

モデルを育てる「学習フェーズ」はNVIDIA、ユーザーに回答を即座に返す「推論フェーズ」はCerebrasという、用途に応じたハードウェアの使い分けが始まっています。 - OpenAIの巧みな戦略

OpenAIはCerebrasと200億ドル規模の契約を結び、自社モデルのインフラを多角化することでNVIDIAへの依存リスクを減らしています。 - 記録的なIPOの成功

地政学的リスクを乗り越え、市場から強烈な支持を集めたことで、CerebrasはAIインフラ市場のメインプレイヤーとして確固たる地位を築きました。

今後の予測と動向の注視

今後、すべてのAI処理をNVIDIAのGPUで行う時代は終わりを告げ、用途に応じて最適なAIチップが選ばれるマルチアーキテクチャの時代へと突入します。CerebrasがNVIDIAを完全に市場から駆逐する可能性は低いものの、これまでNVIDIAが独占していた「推論市場」の巨大なパイを確実に奪っていくでしょう。 一方で、OpenAIがCerebrasへの移行をさらに進めれば、NVIDIAとOpenAIの関係に亀裂が生じるリスクも考えられます。AI業界の覇権争いは、ソフトウェアの開発から、それを動かす物理的なハードウェアの確保へと主戦場を移しています。

私たちがビジネスでAIを活用したり、関連市場への投資を検討する際は、表面的なAIモデルの性能だけでなく「それを裏で動かしているインフラ技術(推論速度やコスト効率)」にまで目を向けることが重要です。Cerebrasが牽引する「超低遅延AI」の時代に、自社のサービスやプロダクトがどう適応できるかを今から模索していく必要があります。

> Cerebras Systems(セレブラス・システムズ) 公式サイト はこちら

みんなのらくらくマガジン 編集長 / 悟知(Satoshi)

SEOとAIの専門家。ガジェット/ゲーム/都市伝説好き。元バンドマン(作詞作曲)。SEO会社やEC運用の経験を活かし、「らくらく」をテーマに執筆。社内AI運用管理も担当。